Gipfelstürmer im Bit-Bereich

Der Name ist kein Zufall, der «Linux Hochleistungs-Rechencluster Matterhorn», so seine offizielle Bezeichnung, ragt mit seiner Rechenkapazität und Geschwindigkeit wahrlich höher in den Himmel als andere Berge. Betrachtet man das Ranking der schnellsten Computer der Welt, so käme Matterhorn dort etwa auf Rang 93. Alexander Godknecht, Leiter der Abteilung Zentrale Server der Informatikdienste der Universität Zürich, gibt allerdings zu bedenken: «Die Entwicklung im Rechencluster-Bereich verläuft rasant.»

700-mal so schnell wie der Heim-PC

Seit Dezember 2003 steht «Matterhorn» an der Universität Irchel im Maschinenraum der Informatikdienste. 522 Prozessoren vom Typ Opteron verleihen ihm eine theoretische Leistung von 1872 Gigaflops (flops = floating operations per second). Das bedeutet: Er ist ungefähr 700 mal so schnell wie ein Heim-PC vom Typ Pentium 4.

Kernstück des «Matterhorn» sind 256 Rechenknoten mit je zwei Prozessoren. Die Rechenknoten sind durch drei unabhängige Netzwerke mit je unterschiedlichen Geschwindigkeiten zu einem sogenannten Cluster verbunden. Eingekauft haben die Informatikdienste diese Technologie bei der Walliseller Firma Dalco – für 1,2 Millionen Franken.

Mehr Parameter, bessere Prognosen

«Matterhorn» soll an der Universität Zürich insbesondere dann zur Anwendung kommen, wenn bei Simulationen und Berechnungen grosse Datenmengen anfallen. Vier universitäre Institute aus dem Bereich Biochemie, Chemie, Physikalische Chemie und Biologie profitieren vom Testbetrieb, der noch bis April 2004 dauert.

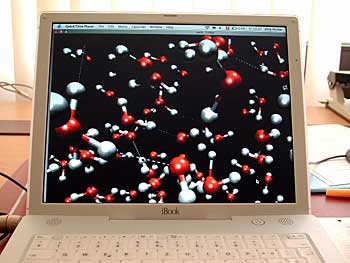

Professor Jürg Hutter vom Physikalisch-chemischen Institut beispielsweise untersucht mit dem «Matterhorn» chemische Reaktionen in Flüssigkeiten:«Im Vergleich zum vorherigen zentralen Rechner können unsere Berechnungen etwa zehnmal so schnell durchgeführt werden. Vor allem aber erlaubt er uns, grössere molekulare Systeme und mehr Parameter zu testen. Dies erhöht die Genauigkeit und unsere Prognosefähigkeit im Hinblick auf die untersuchtenPhänomene.»

«Früh den richtigen Weg beschritten»

Allerdings verlief nicht von Anfang an alles reibungslos. Software und Treiber mussten an die noch nicht sehr verbreitete Opteron-Architektur angepasst werden. Alexander Godknecht: «Die Software-Probleme sind inzwischen zum grössten Teil gelöst. Wir hatten uns sehr früh für diesen Typ von Rechner entschieden, inzwischen zeigt sich, dass wir auf dem richtigen Weg sind. Weltweit werden immer mehr Opteron-Cluster eingesetzt.»

Die entscheidenden Vorteile sieht Godknecht darin, dass Opteron-Prozessoren sowohl 32 wie auch 64 Bit Code rechnen können - bei vergleichbarer Geschwindigkeit. Der Cluster-Aufbau erlaube es zudem, einzelne Hardware-Komponenten jederzeit kostengünstig und schnell durch neue Entwicklungen zu ersetzen oder ergänzen.

Kapazität wird weiter erhöht

Nach dem erfolgreichen Testbetrieb soll «Matterhorn» ab Mai 2004 allen Instituten der Universität Zürich zur Verfügung stehen. In welchen Fällen der Rechencluster die richtige Lösung für ein Informatikbedürfnis ist, werden die Informatikdienste mit den Instituten individuell abklären. Klar ist – auch «Matterhorn» hat nur eine begrenzte Kapazität. Allein im Testbetrieb war diese schon zu 98 Prozent ausgelastet.

Im Laufe des Jahres 2004 ist deshalb bereits ein erster Ausbau des «Matterhorns» geplant. Weiter optimiert werden soll auch die Geschwindigkeit. Christian Bolliger, Informatiker und «Matterhorn»-Betreuer: «Wir kommen an physikalische Grenzen, was aber durchaus der Sinn der Sache ist. Wir werden versuchen, die Geschwindigkeit der Datenübertragung weiter zu erhöhen, ohne dass die Stabilität zu stark darunter leidet. Grundsätzlich sind wir aber jetzt schon sehr zufrieden mit der Leistung von<Matterhorn>.»